ИИ и чипы

«Окно контекста» больших моделей: мифы про миллионы токенов и реальная точность

Почему длинный промпт не равен «помнит всё» и как резать документы с умом

Автор: Алексей Новиков Проверено редакцией

Источник: Hugging Face (документация и блог) · материал источника: 2026-02-05

- LLM

- RAG

- токены

- качество ответов

Что реально даёт большой контекст

Увеличение окна позволяет передать больше первичных данных за один вызов: длинный договор, несколько логов, цепочку переписки. Это удобно для прототипов, но не отменяет стоимость вычислений и задержку — длинные запросы дороже и медленнее на одном и том же железе.

Потеря «середины» и шум

На очень длинных входах модели чаще ошибаются в деталях и путают далёкие фрагменты. Практика показывает: качественный отбор релевантных кусков часто бьёт наивный «засунуть весь архив». Компрессия смысла — отдельная инженерная задача.

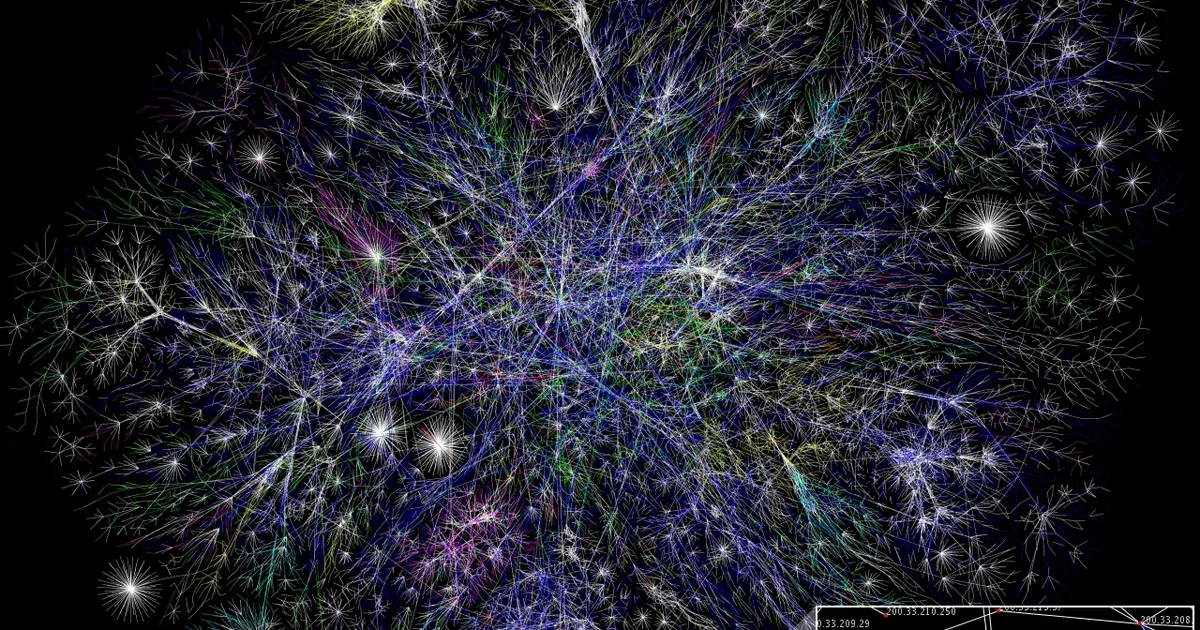

RAG не «против» контекста

Retrieval-Augmented Generation дополняет большое окно: сначала найти 5–15 релевантных абзацев, затем дать модели компактный, проверенный контекст. Так вы снижаете галлюцинации и упрощаете ссылки на источники для пользователя.

Разбиение документов

Делите текст на перекрывающиеся чанки с сохранением заголовков и метаданных. Храните версии документов, чтобы не смешивать устаревшие параграфы. Для кода добавляйте путь к файлу и коммит — иначе модель «видит» фрагмент без привязки к проекту.

Итог

Большое окно — инструмент, а не волшебство. Сочетайте его с осмысленным retrieval, лимитами по токенам и тестами на длинных реальных кейсах. Так вы получите предсказуемое качество вместо маркетинговых цифр в презентациях.

Читайте также

-

ИИ и чипы

«Окно контекста» больших моделей: мифы про миллионы токенов и реальная точность

Почему длинный промпт не равен «помнит всё» и как резать документы с умом

Как устроена потеря внимания на длинных входах и зачем RAG остаётся актуальным даже при огромном контексте.

Алексей Новиков -

ИИ и чипы

SBOM «на минималках»: форматы, генерация в CI и вопросы к поставщикам

SPDX, CycloneDX и что делать с отчётом, кроме хранения в архиве

Как автоматизировать выпуск SBOM для приложений и библиотек и связать его с политикой уязвимостей.

Светлана Воронова -

ИИ и чипы

Нейроускорители в потребительских ПК: что меняется в 2026 году

Почему NPU перестали быть маркетинговой строчкой и начали влиять на реальные сценарии

Локальные нейроускорители в ноутбуках: энергопотребление, приватность и софт — без мифов про «TOPS ради TOPS».

Марина Соколова -

ИИ и чипы

Digital Services Act: что важно командам продуктов и модерации

Прозрачность рекомендаций, отчётность и границы ответственности платформ

Краткий ориентир для техдиректоров: какие артефакты и процессы понадобятся при работе в ЕС.

Алексей Новиков

Обсуждение

Публичные комментарии на сайте временно отключены: мы перенастраиваем модерацию и защиту от спама. Смысловые замечания и указания на ошибки присылайте на editor@techmedia.space — письма с конкретной ссылкой на материал и цитатой фрагмента обрабатываются в приоритетном порядке.